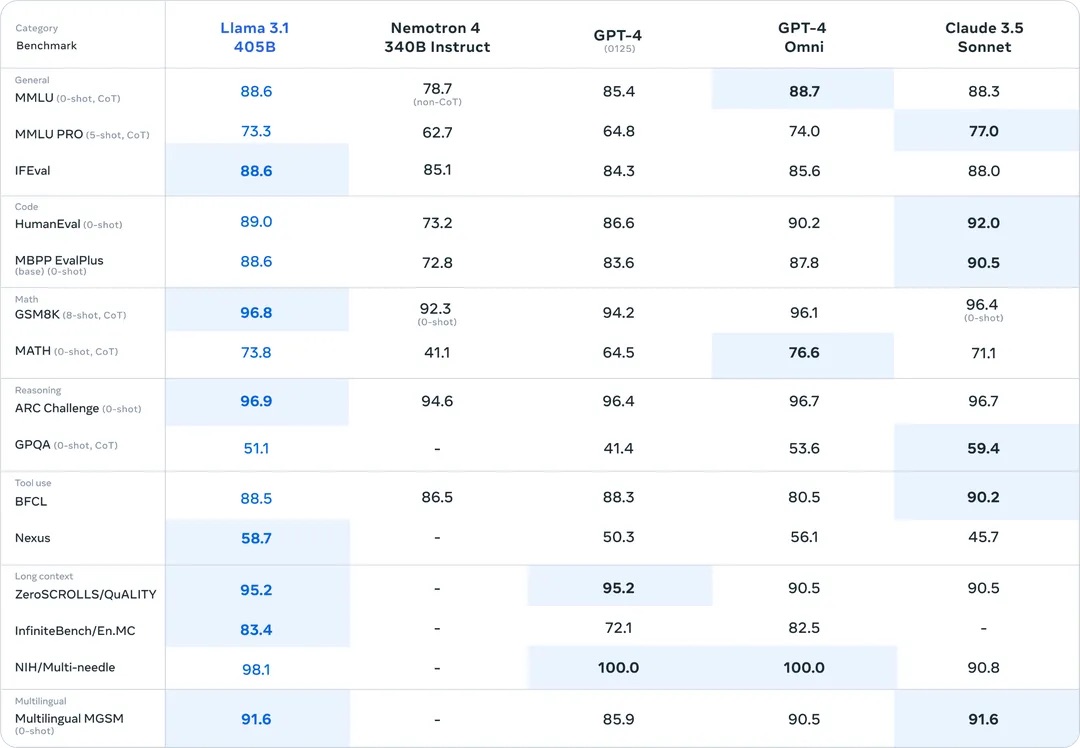

Hôm nay, Meta đã chính thức giới thiệu phiên bản Llama 3.1 – mô hình AI mã nguồn mở lớn nhất hiện nay với hiệu suất được cho là vượt trội hơn so với GPT-4o và Claude 3.5 Sonnet của Anthropic trong một số bài kiểm tra chuẩn.

Ngoài việc cải thiện khả năng hoạt động, Llama 3.1 còn hỗ trợ nhiều quốc gia và ngôn ngữ hơn, đồng thời tích hợp tính năng tạo hình ảnh dựa trên chân dung người dùng. CEO Mark Zuckerberg dự đoán rằng vào cuối năm nay, mô hình này của Meta sẽ trở thành mô hình AI phổ biến nhất trên toàn cầu, vượt qua .

Trước đó vài tháng, Meta đã ra mắt mô hình Llama 3, và giờ đây Llama 3.1 không chỉ có số lượng tham số tăng lên mà còn có hiệu suất vượt trội hơn rất nhiều. Cụ thể, Llama 3.1 sở hữu tới 405 tỷ tham số và được huấn luyện bằng 16.000 GPU H100 từ Nvidia. Mặc dù Meta không công bố chi tiết về chi phí huấn luyện Llama 3.1, nhưng chỉ riêng chi phí cho GPU đã có thể lên đến hàng trăm triệu đô la.

Đối với lý do đầu tư tài chính nhưng vẫn phát hành dưới dạng mã nguồn mở, Zuckerberg cho rằng các mô hình AI mã nguồn mở sẽ phát triển nhanh chóng hơn và có thể vượt qua các mô hình riêng tư. Anh so sánh điều này với Linux, cũng là mã nguồn mở nhưng đã trở thành nền tảng vận hành cho hầu hết điện thoại, máy chủ và nhiều thiết bị công nghệ khác.

Meta thông báo rằng để huấn luyện Llama 3.1, họ đã hợp tác với nhiều công ty khác bao gồm Microsoft, Amazon, Google, Nvidia, Databricks,… nhằm hỗ trợ lập trình viên phát triển phiên bản riêng của họ. Meta khẳng định rằng chi phí cho Llama 3.1 chỉ bằng một nửa so với chi phí của GPT 4o từ OpenAI. Thêm vào đó, Meta cũng phát hành Weight (trọng số) để các công ty khác có thể tự huấn luyện bằng dữ liệu của họ và tùy chỉnh mô hình theo cách mà họ mong muốn.

Meta không công bố cụ thể lượng dữ liệu mà họ đã sử dụng để đào tạo Llama 3.1, cũng như không cung cấp thông tin về nguồn gốc của những dữ liệu này. Một số ý kiến cho rằng đây có thể là một thông tin bị giữ kín vì lý do thương mại, trong khi đó một số khác lại nhận định rằng đây là chiến lược nhằm tránh những vấn đề liên quan đến vi phạm bản quyền. Meta chỉ tiết lộ rằng họ đã sử dụng dữ liệu tổng hợp hoặc dữ liệu được tạo ra từ các mô hình thay vì dữ liệu do con người cung cấp.

Khi được hỏi về tình trạng cạn kiệt dữ liệu huấn luyện, Meta cho rằng điều này có thể xảy ra nhưng vẫn còn một khoảng thời gian dài trước khi điều đó trở thành hiện thực. Bên cạnh đó, Meta cũng thông báo rằng với việc phát triển Llama 3.1, họ lần đầu tiên đã sử dụng một đội ngũ kiểm thử chuyên nghiệp để đánh giá những vấn đề tiềm ẩn liên quan đến an ninh mạng và các vấn đề sinh hóa.

Kết quả cuối cùng đã cho ra đời mô hình Llama 3.1 với 405 tỷ tham số, con số này vượt xa so với 70 tỷ và 8 tỷ tham số ở các phiên bản trước. Giám đốc bộ phận trí tuệ nhân tạo của Meta cho biết rằng Llama 3.1 sẽ được các nhà phát triển áp dụng rộng rãi như “một người hướng dẫn để đào tạo các mô hình nhỏ hơn mà họ triển khai một cách tiết kiệm chi phí.”

Trong một ví dụ cụ thể, Meta cho hay Llama 3.1 có khả năng kết nối với các API của công cụ tìm kiếm để “truy xuất thông tin từ internet dựa trên một yêu cầu phức tạp và sử dụng nhiều công cụ liên tiếp nhằm hoàn thành nhiệm vụ đã được giao.” Chẳng hạn, người dùng có thể yêu cầu mô hình cung cấp số lượng nhà được bán trên toàn nước Mỹ trong vòng 5 năm qua, và nó sẽ thực hiện việc tìm kiếm, tạo mã Python và vẽ biểu đồ để thể hiện các dữ liệu đó.

Với sự hỗ trợ của Llama 3.1, Meta đã phát triển một chatbot AI tương tự như của OpenAI, dự kiến sẽ được tích hợp vào Facebook, Instagram và WhatsApp. Bắt đầu từ tuần này, người dùng tại Mỹ đã có thể truy cập vào Llama 3.1 thông qua WhatsApp và trang web AI của Meta. Các ứng dụng Facebook và Instagram sẽ nhận được bản cập nhật trong vài tuần tới. Đồng thời, Llama 3.1 cũng sẽ bổ sung thêm nhiều ngôn ngữ như Pháp, Đức, Hindi, Ý và Tây Ban Nha.

Chatbot AI này sẽ sử dụng mô hình Llama 3.1 với 405 tỷ tham số, và sau một số tác vụ nhất định, người dùng sẽ được chuyển sang sử dụng mô hình Llama 3.1 với 70 tỷ tham số. Điều này cho thấy mô hình Llama 3.1 với 405 tỷ tham số thực sự là rất tốn kém đối với Meta để triển khai cho tất cả mọi người. Hiện vẫn chưa xác định rõ mức ngưỡng tiêu thụ tài nguyên này là bao nhiêu.

Cuối cùng, Meta đã giới thiệu một tính năng AI mới mang tên Imagine Me, cho phép người dùng tải lên ảnh chân dung để tạo ra các bức tranh khác bằng AI. Với việc tạo ra hình ảnh AI theo cách này, Meta hy vọng sẽ đáp ứng nhu cầu sáng tạo hình ảnh của người dùng mà không gây ra những vấn đề giống như deepfake. Nói cách khác, Meta xem đây là giải pháp để phân định rõ hơn giữa hình ảnh thật và những hình ảnh do AI tạo ra.