Mục lục

Trong bối cảnh nhu cầu xử lý trí tuệ nhân tạo (AI) ngày càng tăng cao, ba ông lớn ngành công nghệ bộ nhớ là Micron, Samsung và SK Hynix vừa chính thức hé lộ thế hệ bộ nhớ HBM4 và HBM4e mới tại sự kiện GTC 2025 của NVIDIA. Đây là bước tiến lớn trong cuộc đua cung cấp giải pháp lưu trữ băng thông cao phục vụ các hệ thống tăng tốc AI hiện đại.

Các dòng bộ nhớ HBM4 hứa hẹn mang lại mật độ dữ liệu và băng thông vượt trội so với thế hệ HBM3e hiện tại. Với tốc độ truyền dữ liệu cao và dung lượng lớn, HBM4 được kỳ vọng sẽ là trụ cột trong kiến trúc phần cứng của các siêu máy tính AI thế hệ mới.

HBM4: Cải tiến mạnh mẽ về tốc độ và dung lượng

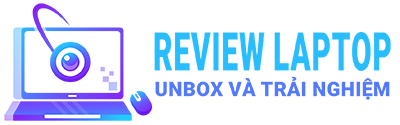

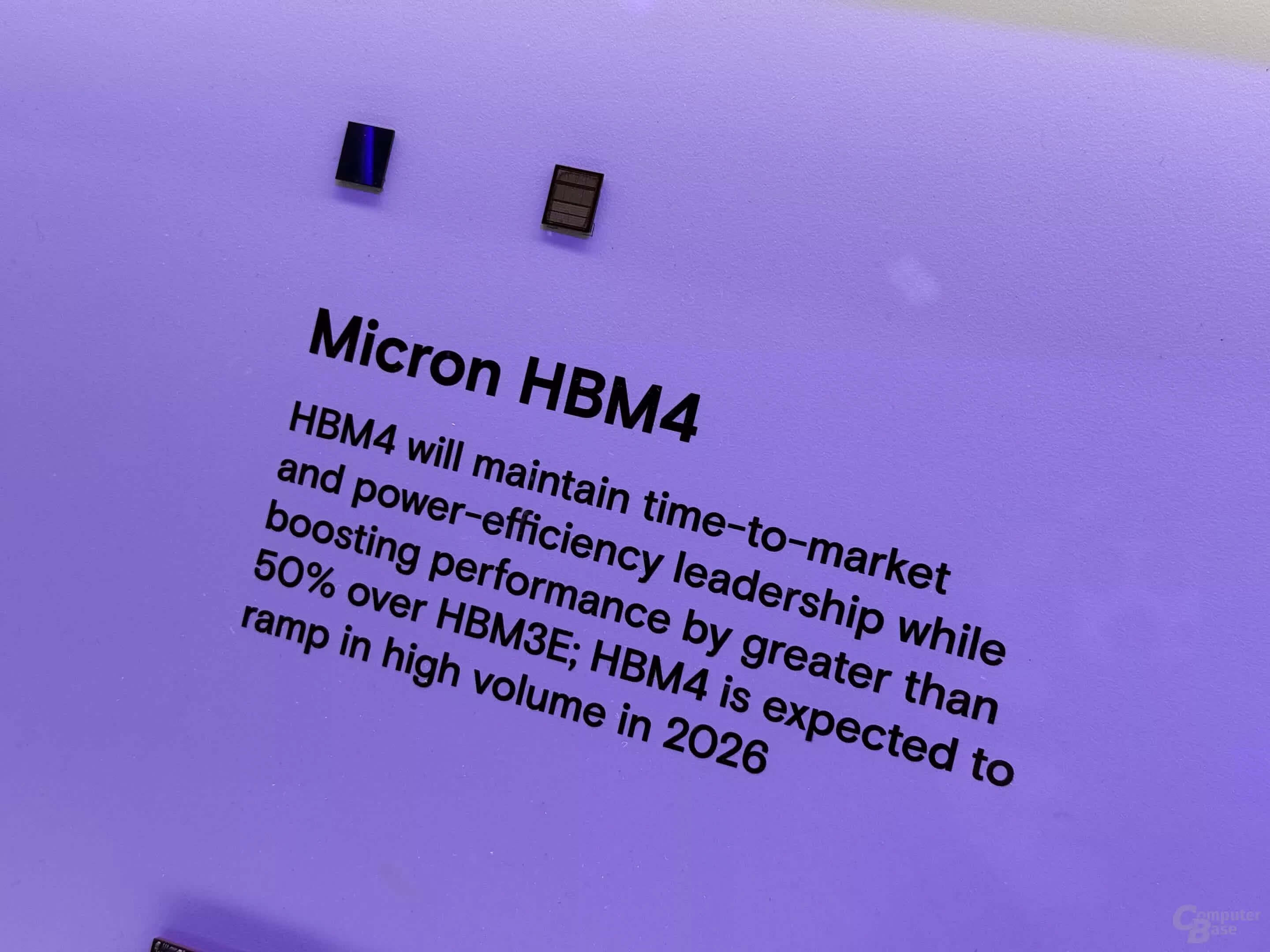

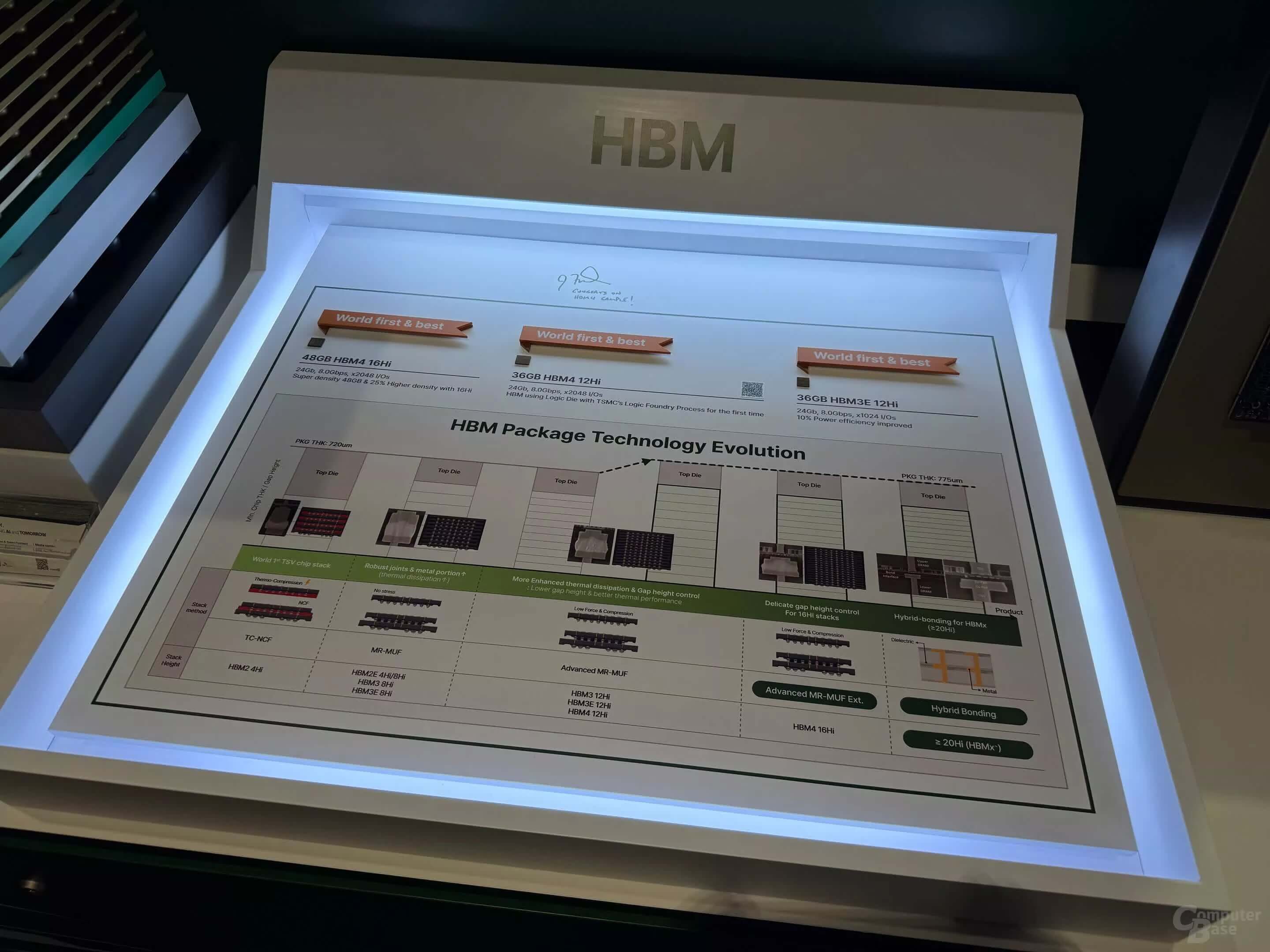

Tại sự kiện GTC, cả ba nhà sản xuất đều giới thiệu các nguyên mẫu HBM4 stack với cấu hình 16 lớp, mỗi lớp dung lượng 3GB, cho tổng cộng 48GB. Cụ thể, SK Hynix công bố giải pháp HBM4 đầu tiên với tốc độ 8Gbps, trong khi Samsung khẳng định có thể đạt đến 9.2Gbps trong cùng thế hệ. Micron cũng không đứng ngoài cuộc khi tuyên bố hiệu suất bộ nhớ của họ sẽ cao hơn 50% so với HBM3e.

Dự kiến trong năm 2026, các sản phẩm HBM4 thương mại phổ biến sẽ sử dụng cấu hình 12 lớp với tổng dung lượng 36GB. Những con số này mở ra khả năng mở rộng băng thông và bộ nhớ rất lớn, hỗ trợ hiệu quả cho các tác vụ AI như huấn luyện mô hình ngôn ngữ lớn (LLM), thị giác máy tính và học tăng cường.

HBM4e: Hướng đến dung lượng “khủng” cho GPU AI

Không dừng lại ở HBM4, các nhà sản xuất đã hé lộ lộ trình phát triển HBM4e với những bước nhảy vọt về dung lượng và tốc độ. Samsung đang hướng tới DRAM với mật độ 32Gb mỗi lớp, cho phép tạo ra các stack HBM4e có dung lượng 48GB đến 64GB, đạt tốc độ truyền từ 9.2 đến 10Gbps. SK Hynix còn tham vọng hơn khi gợi ý khả năng tạo ra stack 20 lớp sử dụng chip 3GB, đạt tới 60-64GB cho mỗi stack.

Các giải pháp này đặc biệt phù hợp với dòng GPU NVIDIA Rubin dự kiến ra mắt vào năm 2027. NVIDIA đã xác nhận Rubin Ultra sẽ sử dụng tới 16 stack HBM4e cho mỗi GPU, tương đương 1TB bộ nhớ mỗi card và băng thông lên đến 4.6PB/s. Với cấu hình hệ thống NVL576, tổng dung lượng bộ nhớ có thể đạt 365TB, vượt xa giới hạn hiện tại của AI hardware.

Tiềm năng lớn nhưng không dành cho người dùng phổ thông

Dù HBM4 và HBM4e hứa hẹn thay đổi cục diện AI, giá thành cao là yếu tố khiến các dòng card đồ họa tiêu dùngkhó có thể tiếp cận công nghệ này trong tương lai gần. Theo VideoCardz, chi phí sản xuất và tích hợp bộ nhớ HBM vẫn rất cao, do đó sẽ chủ yếu xuất hiện trong các hệ thống AI chuyên dụng và trung tâm dữ liệu quy mô lớn.

Tuy nhiên, trong bối cảnh AI đang trở thành trọng tâm phát triển của nhiều ngành công nghiệp, các thế hệ bộ nhớ mới như HBM4 đóng vai trò then chốt trong việc mở rộng năng lực xử lý, tăng hiệu suất và giảm độ trễ hệ thống. Nếu các hãng sản xuất đạt được mục tiêu về mật độ và băng thông, đây sẽ là cú huých quan trọng thúc đẩy các ứng dụng AI trong 5 năm tới.

HBM4 mở đường cho siêu máy tính AI tương lai

Sự xuất hiện của HBM4 và HBM4e là minh chứng rõ ràng cho xu hướng phần cứng đang dịch chuyển mạnh mẽ theo hướng phục vụ AI. Với sự hợp tác chặt chẽ từ NVIDIA và các hãng bộ nhớ hàng đầu, tương lai của AI có thể sẽ được thúc đẩy bởi những bước tiến vượt bậc trong công nghệ lưu trữ băng thông cao. Người dùng có thể không sớm được trải nghiệm HBM4 trong PC cá nhân, nhưng các trung tâm dữ liệu và siêu máy tính chắc chắn sẽ là nơi công nghệ này phát huy tối đa sức mạnh.